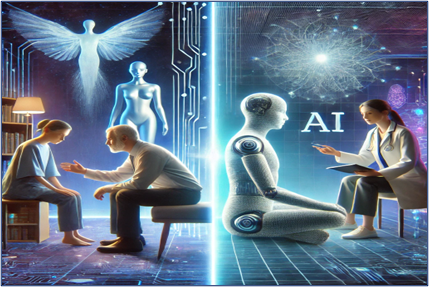

La incorporación de la inteligencia artificial (IA) en la atención psicológica ha abierto un mundo de posibilidades, desde diagnósticos más precisos hasta intervenciones personalizadas. Sin embargo, esta revolución tecnológica también plantea dilemas éticos significativos que los profesionales de la salud mental no pueden ignorar. ¿Cómo garantizamos la privacidad de los datos de los pacientes? ¿Quién es responsable cuando un algoritmo comete un error? ¿Cómo mantenemos el balance entre la eficiencia tecnológica y la conexión humana que es fundamental en la terapia? En este artículo, reflexionaremos sobre estos desafíos, respaldados por casos clínicos reales, análisis detallados y estrategias prácticas para abordar estos dilemas éticos.

- Privacidad y confidencialidad de los datos

Uno de los mayores desafíos éticos de la IA en la atención psicológica es la protección de la privacidad y la confidencialidad de los datos de los pacientes. Las plataformas de IA suelen requerir acceso a información sensible, como historiales clínicos, registros de sesiones terapéuticas y datos biométricos.

Caso clínico: En un hospital de Boston, se implementó un sistema de IA para analizar las notas de sesiones terapéuticas y detectar patrones emocionales en pacientes con trastornos de ansiedad. Aunque el sistema demostró ser efectivo, surgieron preocupaciones sobre la seguridad de los datos. En un caso específico, un paciente expresó su preocupación por la posibilidad de que su información fuera accedida por terceros no autorizados.

Análisis: Este caso subraya la importancia de garantizar la seguridad de los datos y la transparencia en su uso. Los psicólogos deben asegurarse de que las plataformas de IA cumplan con estándares rigurosos de protección de datos y que los pacientes comprendan cómo se utiliza su información.

- Responsabilidad en la toma de decisiones

Otro dilema ético es la responsabilidad en la toma de decisiones. Cuando un algoritmo de IA recomienda un tratamiento o diagnóstico, ¿quién es responsable si algo sale mal? ¿El desarrollador del algoritmo, el psicólogo que lo utiliza o la institución que lo implementa?

Caso clínico: En una clínica de salud mental en Toronto, se utilizó un algoritmo de IA para recomendar tratamientos para pacientes con depresión. En un caso específico, el sistema sugirió una combinación de terapia cognitivo-conductual (TCC) y medicación para una paciente de 35 años. Después de varias semanas, la paciente experimentó efectos secundarios severos debido a la medicación recomendada.

Análisis: Este caso ilustra la complejidad de la responsabilidad en la toma de decisiones asistida por IA. Los psicólogos deben utilizar estas herramientas como un complemento y no como un sustituto de su juicio clínico. Además, es crucial que los desarrolladores de algoritmos sean transparentes sobre las limitaciones y riesgos de sus herramientas.

- Balance entre tecnología y conexión humana

Aunque la IA puede optimizar muchos aspectos de la atención psicológica, existe el riesgo de que la tecnología reemplace la conexión humana que es fundamental en la terapia. ¿Cómo mantenemos el balance entre la eficiencia tecnológica y la empatía?

Caso clínico: En una consulta privada en México, un psicólogo utilizó un chatbot terapéutico para complementar el tratamiento de un adolescente con ansiedad social. Aunque el chatbot proporcionaba ejercicios de relajación y técnicas de exposición gradual entre sesiones, el psicólogo dedicó tiempo en cada sesión a discutir las experiencias del paciente con la herramienta y a explorar sus emociones en profundidad. Esta combinación de tecnología y empatía resultó en una mejora del 40% en los niveles de ansiedad del paciente después de ocho semanas.

Análisis: Este caso demuestra cómo la IA puede ser integrada de manera efectiva sin comprometer la conexión humana. Al priorizar la empatía y el entendimiento en cada interacción, los psicólogos pueden aprovechar lo mejor de ambos mundos.

Tips y Estrategias para abordar los dilemas éticos

- Garantizar la privacidad y la confidencialidad:

- Asegúrese de que las plataformas de IA cumplan con estándares rigurosos de protección de datos.

- Explique a los pacientes cómo se utiliza su información y obtenga su consentimiento informado.

- Mantener la responsabilidad clínica:

- Utilice la IA como un complemento y no como un sustituto de su juicio clínico.

- Sea transparente con los pacientes sobre las limitaciones y riesgos de las herramientas de IA.

- Priorizar la conexión humana:

- Dedique tiempo en cada sesión a explorar las emociones y experiencias de los pacientes.

- Utilice la IA como una herramienta de apoyo, pero mantenga el enfoque en la empatía y el entendimiento.

Conclusión

La inteligencia artificial está transformando la atención psicológica, ofreciendo herramientas innovadoras que pueden mejorar la eficacia y accesibilidad de los tratamientos. Sin embargo, su incorporación plantea dilemas éticos significativos que los profesionales de la salud mental deben abordar con cuidado. Desde la protección de la privacidad hasta la responsabilidad en la toma de decisiones y el balance entre tecnología y conexión humana, es fundamental que los psicólogos utilicen estas herramientas de manera ética y responsable.

Como experto en este campo, he tenido el privilegio de observar de cerca estos avances y analizar su impacto en la práctica clínica. La IA no es una solución mágica, pero es un aliado invaluable en nuestra misión de proporcionar atención psicológica de alta calidad, siempre y cuando se utilice con ética y empatía.

Psic. Georgios Meroussis

Referencias

- Hospital de Boston. (2023). «AI and Privacy Concerns in Mental Health: A Case Study.»

- Clínica de Salud Mental de Toronto. (2023). «Responsibility in AI-Assisted Decision Making: A Case Study.»

- Consulta Privada en México. (2023). «Balancing Technology and Human Connection: A Case Study.»

#InteligenciaArtificial #Psicología #SaludMental #ÉticaEnSalud #TecnologíaYPsicología #ConexiónHumana